只需一句话,你的电脑就能像拥有了一位理解你意图的助手,打开软件、整理文件、预订机票——这不是科幻电影,而是字节跳动开源的UI-TARS正在创造的现实。

“帮我查看GitHub上UI-TARS项目最新的开放议题。”

指令下达后,屏幕上鼠标指针自动移动、点击,浏览器打开项目页面,准确筛选并提取出最新议题列表。整个过程无需人工介入,仿佛一个隐形的数字员工在执行任务。

这正是字节跳动UI-TARS系统的实际应用场景。这个项目在GitHub上以超过26,000星标的热度成为2026年初最受瞩目的AI开源项目之一。

作为一套多模态AI智能体系统,UI-TARS正在从根本上改变人与计算机的交互模式——从传统的键盘鼠标操作,转向最自然的语言交流。

01 进化之路:从规则脚本到原生智能体的技术跃迁

传统GUI自动化工具如Selenium和AutoHotkey,依赖精确的元素定位和预定义脚本。这种规则导向的方法在面对界面变更、动态内容或跨平台需求时,往往显得脆弱且维护成本高昂。

RPA(机器人流程自动化)虽有所进步,但仍需要专业人员编写复杂脚本,部署成功率不足60%。

UI-TARS标志着从模块化自动化到端到端原生智能体的根本性转变。它采用统一策略循环,将视觉感知、推理、动作和记忆整合到单一模型中。

系统通过大规模GUI截图训练的视觉模型,使AI能够像人类一样“看懂”界面,理解按钮位置、文字含义和界面状态,而非依赖脆弱的代码定位。

02 技术核心:四大支柱构建的智能交互系统

UI-TARS的强大功能源于其多层次的技术架构,四个关键技术支柱共同支撑起它的智能交互能力。

统一的策略循环架构:UI-TARS-2采用基于532M参数视觉编码器的专家混合Transformer架构。该策略统一处理多模态观察、记忆和任务指令,将感知、动作定位和系统级推理整合到端到端的学习框架中。

思维增强规划机制:系统引入明确的System-2推理机制,通过中间“思维”令牌支持复杂多步骤决策。这些思维令牌编码了任务分解、里程碑识别、反思和试错等推理模式,使AI能够像人类一样思考问题解决路径。

反思式数据飞轮:UI-TARS建立了迭代数据生成机制,包含持续预训练、监督微调和强化学习的循环。系统部署在大型虚拟设备池上,通过多阶段过滤和错误校正,不断自我完善。

混合GUI-SDK环境:除了纯GUI交互,UI-TARS-2还集成了混合GUI-SDK后端,允许代理执行屏幕操作的同时,访问文件系统、调用SDK工具,甚至使用嵌入式开发环境。这种设计极大地扩展了系统的应用范围。

表:UI-TARS核心组件功能解析

| 组件模块 | 功能描述 | 技术特点 |

|---|---|---|

| 视觉编码器 | 处理屏幕截图,提取UI元素特征 | 基于CLIP-like模型,参数达532M |

| 语言解码器 | 理解指令并生成动作 | 支持多模态输入,动态规划执行路径 |

| 动作规划器 | 将自然语言映射为API调用 | 输出点击坐标、文本输入等具体操作 |

| 工具集成器 | 连接浏览器、文件、命令行等工具 | 支持MCP协议,可扩展性强 |

03 性能对决:开源模型如何挑战行业巨头

在权威的OSWorld基准测试中,UI-TARS-2取得了47.5分的成绩,超越了OpenAI o3的42.9分和Claude-4的43.9分。

在AndroidWorld移动自动化测试中,UI-TARS-2更是以73.3分的优异成绩,明显领先于OpenAI o3的52.5分。

特别值得一提的是,在11款Poki游戏的测试中,UI-TARS-1.5实现了100%的完成率,而OpenAI CUA和Claude 3.7在这些游戏中的表现则相形见绌。

这一性能优势源于UI-TARS独特的强化学习框架。系统采用近端策略优化,并引入解耦GAE、长度自适应GAE、值预训练和差异化剪裁等增强技术。这些创新显著提升了系统在长序列任务中的稳定性。

表:UI-TARS-2与竞争模型性能对比(基于OSWorld基准)

| 模型 | OSWorld分数 | AndroidWorld分数 | BrowseComp-zh | 关键特点 |

|---|---|---|---|---|

| UI-TARS-2 | 47.5 | 73.3 | 50.5 | 混合GUI-SDK,统一策略循环 |

| OpenAI o3 | 42.9 | 52.5 | 未提供 | 商业闭源,推理能力强 |

| Claude-4 | 43.9 | 未提供 | 22.5 | 长上下文,强推理能力 |

| UI-TARS-1.5 | 42.5 | 64.2 | 未提供 | 轻量化,适合本地部署 |

04 实际应用:从个人助手到企业自动化的多场景落地

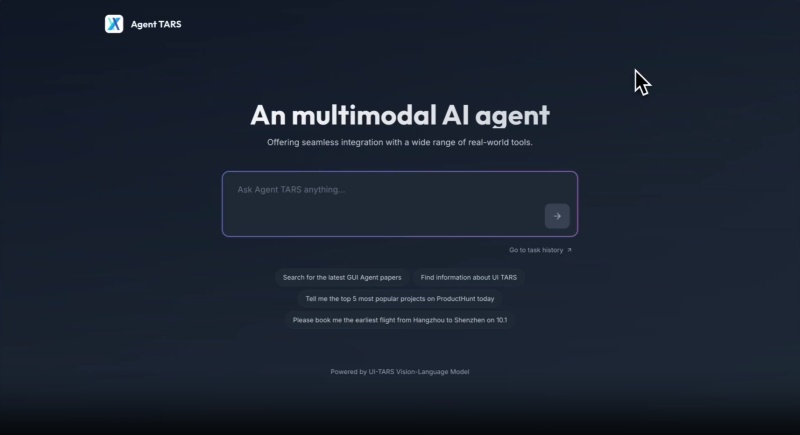

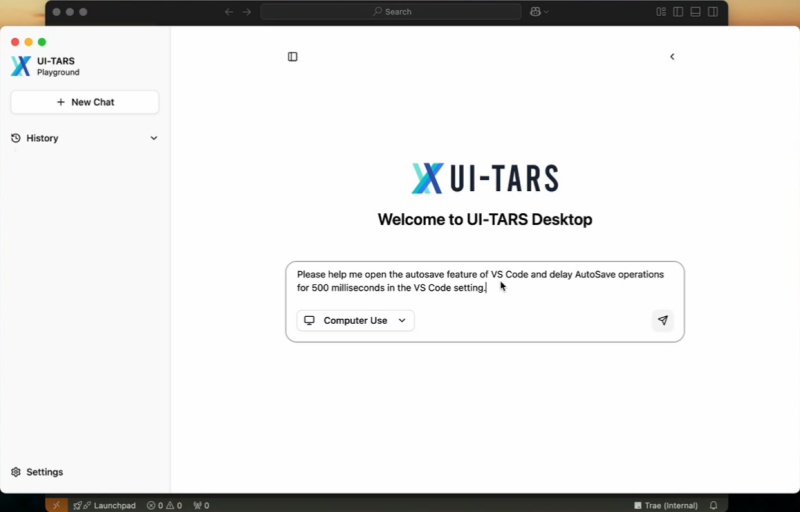

UI-TARS-desktop提供了桌面应用程序,基于UI-TARS模型提供原生GUI代理,支持本地计算机和浏览器操作。

个人效率提升:对于普通用户,UI-TARS可以轻松处理日常任务。“帮我整理桌面文件按类型分类”、“打开Chrome搜索今天的热点新闻”、“调整系统设置将夜间模式开启”——这些过去需要多次点击的操作,现在只需一句话就能完成。

企业自动化革命:在企业环境中,UI-TARS能够自动化处理大量重复性工作。数据显示,传统RPA需要专业人员编写流程脚本,而UI-TARS通过自然语言指令可完成复杂任务,预计使流程自动化部署效率提升3-5倍。

开发者生产力工具:对于开发者,UI-TARS可作为智能测试代理,自动遍历界面功能、验证交互逻辑。同时,项目提供完整的CLI工具和SDK,开发者可以用JavaScript编排复杂工作流,实现更高级的自动化。

05 实战部署:三步拥有你的AI数字员工

环境准备:UI-TARS-desktop支持Windows和macOS系统。对于开发者版本,需要确保已安装Node.js(版本>=22)。项目同时提供Docker镜像,便于快速部署。

快速启动:

访问GitHub仓库:

https://github.com/bytedance/UI-TARS-desktop下载对应系统安装包(约300MB)

安装并授予必要的屏幕录制和辅助功能权限

模型选择与配置:UI-TARS提供多种模型选项。轻量级的Qwen3-4B版本适合消费级显卡(如RTX 3060),而性能更强的UI-TARS-1.5-7B版本则平衡了能力与资源需求。用户可根据自身硬件条件和任务需求灵活选择。

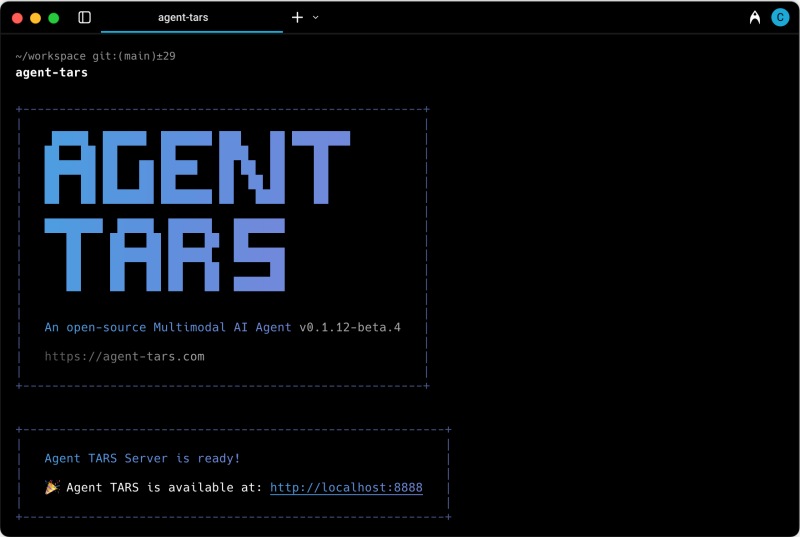

进阶使用:对于开发者,可以通过命令行快速启动:npx @agent-tars/cli@latest。系统支持多种模型提供商,包括火山引擎、Anthropic等,用户可以根据需要配置相应的API密钥。

06 开源生态与产业影响:重新定义AI竞争格局

UI-TARS的成功不仅是技术突破,也反映了开源模式在AI领域的强大生命力。截至2026年2月,UI-TARS-desktop在GitHub上获得超过26,000星标,成为AI智能体开发领域的焦点项目。

与商业闭源方案(如OpenAI Operator每月200美元的费用)相比,UI-TARS的完全免费、Apache 2.0协议开源特性,为更广泛的开发者社区和企业用户提供了可访问的先进技术。

在产业定位上,专业分析指出:“虽然AskUI作为计算机使用代理处理整个执行过程,但UI-TARS专注于坐标预测的数学精度”。这一精准定位使UI-TARS常被集成到其他系统中,确保在密集的专业GUI环境中实现亚像素级的准确性。

开源社区围绕UI-TARS已形成活跃的生态系统。GitHub上的项目讨论区、Discord技术社区(https://discord.gg/pTXwYVjfcs)以及官方技术支持邮箱(TARS@bytedance.com),构建了多层次的支持网络。

随着远程计算机操作器和远程浏览器操作器等新功能的加入,以及多模态交互和智能学习能力的持续增强,这个“会看会做”的AI助手正在逐步打破数字世界与人类意图之间的最后屏障。

当语言成为最直接的命令,当屏幕上的每个像素都能被理解,人机协作的新纪元已经悄然开启。一个能够“看见”并“操作”的数字员工时代,正随着UI-TARS这样的开源项目,悄然成为现实。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...