4月24日,DeepSeek在历经15个月的等待和三次跳票后,终于正式发布并开源了全新一代大语言模型DeepSeek V4预览版。巧合的是,OpenAI在前一天刚刚上线了GPT 5.5,闭源与开源两种定价逻辑就这样面对面呈现在了市场面前。

作为一家专注企业AI服务领域的观察者,企小脉第一时间梳理了这次发布的核心信息。在我看来,DeepSeek V4不仅仅是一次模型升级,更代表了中国开源大模型从“拼参数”到“拼效率”、从“聊天便宜”到“Agent廉价”的范式转变。本文将站在行业观察者的角度,从核心特性、技术创新、市场影响三个维度深度解读V4,并给出我的分析与建议。

一、双剑齐发:Pro旗舰与Flash快刀

DeepSeek V4本次发布了两个版本:旗舰版V4 Pro与经济型V4 Flash,均采用MoE混合专家架构。

V4 Pro定位性能上限,总参数量高达1.6万亿(激活参数490亿),预训练数据33万亿 tokens,在Agent能力、世界知识和推理性能三大维度对标国际顶级闭源模型。据官方披露,DeepSeek内部员工已将其作为日常Agentic Coding工具使用,评测反馈使用体验优于Claude Sonnet 4.5,交付质量接近Opus 4.6非思考模式。在世界知识测评中,V4 Pro大幅领先其他开源模型,仅稍逊于Gemini-Pro-3.1;在数学、STEM及竞赛型代码等硬核领域,V4 Pro超越所有已公开评测的开源模型,比肩世界顶级闭源模型。

V4 Flash是更快捷、经济的轻量化选项,总参数2840亿(激活130亿),推理能力接近Pro版,但世界知识储备稍逊。在简单Agent任务上与Pro版旗鼓相当,高难度任务仍有差距。Flash版的最大优势在于响应速度和API成本——每百万tokens输入仅1元(缓存命中0.2元),输出仅2元。

两款模型均支持百万字超长上下文,并同时支持非思考模式与思考模式(可通过 reasoning_effort 参数设定 high/max 强度),支持Json Output、Tool Calls等企业级功能,且已针对Claude Code、OpenClaw等主流Agent产品进行了专项适配优化。

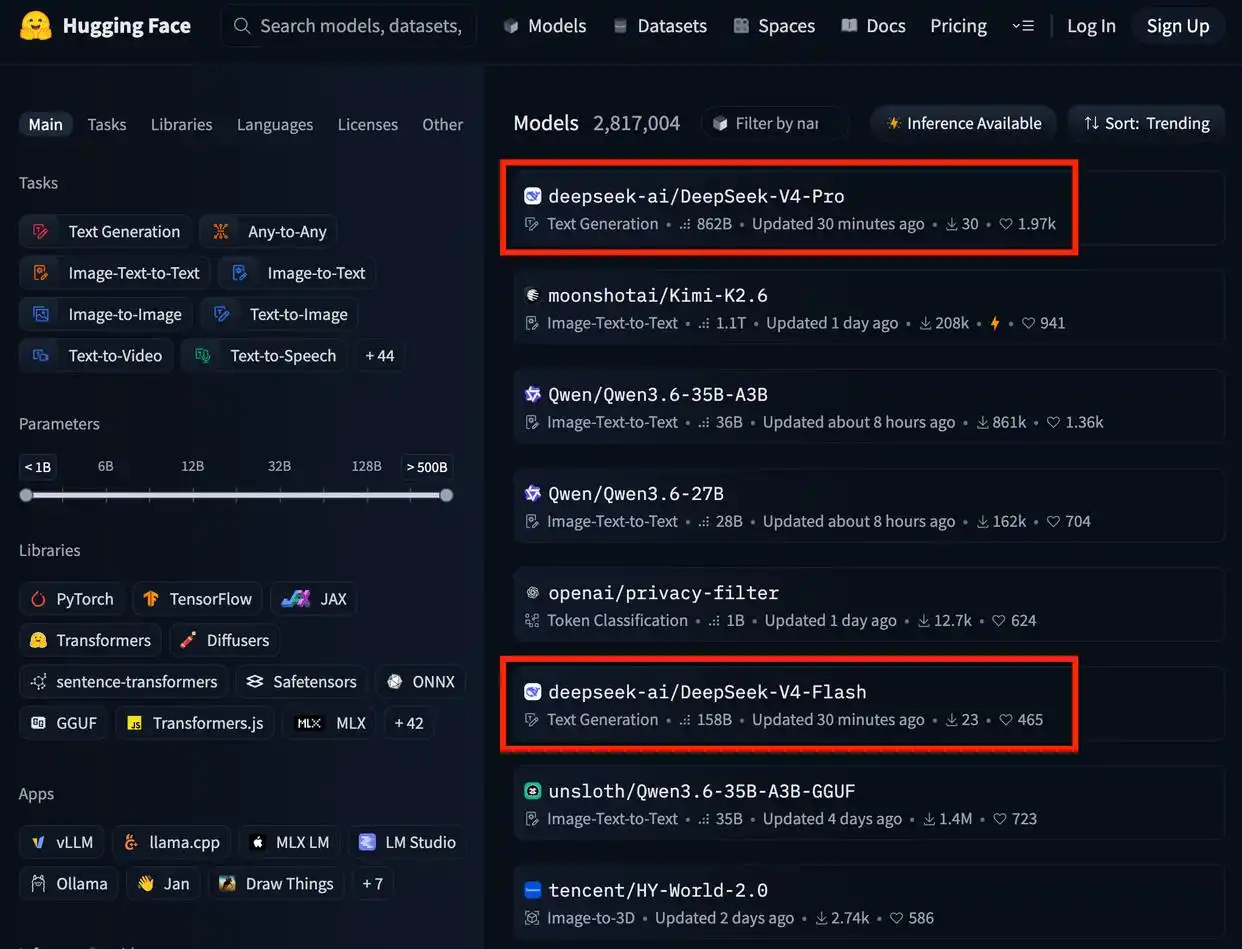

在API衔接方面,DeepSeek继承了此前兼容OpenAI ChatCompletions接口与Anthropic接口的路线,开发者仅需修改 model 参数即可调用。已上架Hugging Face和ModelScope平台,采用MIT协议完全开源,支持本地部署。

二、长上下文从高端功能变为基础设施

在过去一年里,百万级上下文窗口几乎成为闭源旗舰模型的标配能力,但高昂的计算成本使其与绝大多数开发者绝缘。DeepSeek V4的发布正在改变这一格局——从现在开始,1M超长上下文将成为DeepSeek所有官方服务的标配。

从技术角度看,这一突破得益于DeepSeek V4开创的全新混合注意力机制。模型在token维度进行压缩,结合自研的DSA稀疏注意力技术,从根本上改变了大模型处理长序列的方式:强关联的token精读,弱关联的压缩或跳过。这套机制从预训练阶段就重新定义了注意力计算的效率边界。

以下亮点颇为关键:

- 算力效率颠覆性提升:在100万token场景下,V4 Pro的单token推理计算量(FLOPs)仅有前代V3.2的27%,KV缓存用量仅为前代的10%。这意味着此前无法商业化的长文本推理场景,如今在同样的硬件上可以经济实惠地大规模部署。

- 异步释放的缓存机制:V4的API定价体系引入了缓存命中/未命中差异化计费策略——对于命中长上下文缓存的部分,输入价格会被压到极低(Pro版1元/百万,Flash版0.2元/百万)。这种“长任务首token贵、后续token便宜”的设计,让企业级RAG知识库、多轮Agent对话等长程场景的成本结构实现了质变。

让我印象深刻的是,就在DeepSeek V4发布的前一天,OpenAI刚刚上线GPT 5.5,每百万输出token定价30美元。而DeepSeek V4 Flash的输出价为2元人民币/百万token,折合不到0.3美元。对比之下,价格差距超过100倍。V4 Flash输出价格仅为GPT-5.5 Pro的1.55‰。

从官方信息来看,受限于高端算力,目前Pro服务吞吐十分有限,预计下半年昇腾950超节点批量上市后,Pro的价格将大幅下调。

三、Agent能力:从“聊天便宜”到“Agent廉价”

DeepSeek V4产品介绍文章中,Agent一词出现了多达11次。这绝非巧合——V4的核心战略定位,正是将大模型的普惠从对话场景延伸到复杂Agent任务领域。

在Agentic Coding评测中,V4 Pro已达到开源模型最佳水平,据评测反馈使用体验优于Sonnet 4.5。有实测显示,DeepSeek V4 Pro能够连续自主编程60分钟以上,无需人工干预,完成复杂的数据库设计和安卓模拟器开发等工程任务,展现出强大的长程规划、自我纠错和工具调用能力。

这一能力提升得益于V4系列对主流Agent产品的专项适配与优化,覆盖Claude Code、OpenCode等多个框架。在DeepSeek产品矩阵中,专家模式对应V4 Pro,负责处理复杂推理和长上下文高阶任务;快速模式对应V4 Flash,覆盖开发、办公等高频应用场景。

此外,V4的双版本矩阵本身体现了深意:Pro对标顶级闭源Agent能力,Flash走Agent普惠路线。业内正热议,大模型价格战的赛点正从“聊天便宜”转向“Agent廉价”,DeepSeek V4凭借稀疏注意力和同策略蒸馏技术,进一步压低了Agent推理成本。

四、市场影响:开源力量的信号

DeepSeek V4一发布便火速登顶Hugging Face模型榜首。发布当日OpenRouter平台调用量即突破7亿Token,资本市场亦迅速反应,海光信息上涨6.77%。

然而冷静观察后不难发现,深度求索这次呈现的叙事中存在几处克制信号:

其一是性能谦词:DeepSeek主动承认V4 Pro与Opus 4.6思考模式仍存在差距,技术报告中更明确指出,Pro Max模式在标准推理基准上总体约落后前沿闭源模型3–6个月。这种“主动划出差距”的做法在国产模型话术中并不多见,更凸显技术自信。

其二算力短板:官方明确标注,因高端算力受限,目前Pro版的服务吞吐十分有限。这也解释了为什么DeepSeek从2025年开始将训练框架从英伟达迁移到华为昇腾。此过程并不平坦——2025年年中内部曾经历一次比较严重的训练失败。这提醒我们:国产大模型的苦旅还在路上。

五、我的看法与建议

基于以上梳理与分析,我对DeepSeek V4持积极但审慎的态度。接下来我想从三个维度给出看法和建议。

维度一:核心展望

这次V4发布的行业信号不容低估——DeepSeek把“1M上下文”做成了标配,这件事本身就意义深远。一年前,百万级上下文还是少数闭源旗舰模型专属,如今以开源形式向所有开发者开放。这是一次对行业成本预期的重新校准——与其追逐单一维度的参数竞赛,不如投向“参数规模、激活效率、上下文长度”三重平衡。

维度二:挑战与隐忧

从已有信息来看,V4系列仍面临几个问题:

一是推理稳定性不足。实测数据显示,在海龟汤等逻辑推理题上V4表现出色,但在IMO数学难题和部分轻量级测试中,模型会陷入死循环或给出错误答案。Pro版在回答简单问题时有时会陷入“过度思考”,反而不如Flash版效率高。这说明高难度推理的鲁棒性还有提升空间。

二是缺少多模态能力。尽管此前的消息面有诸多关于多模态的猜测,但官方确认V4依然是纯文本大模型,多模态生成暂未纳入本次发布路线图。从商业化角度,缺少视觉能力的通用大模型,在电商、医疗、教育等领域落地的想象空间会相应受到限制。

三是算力瓶颈明显。Pro版受限于昇腾适配的吞吐上限,下半年才能释放产能。对企业用户来说,当模型成本成为竞争优势的核心变量,硬件供应链的安全性和规模化进度同样关乎商用体验。

维度三:对开发者和企业的建议

第一,Pro与Flash搭配使用。Agent类复杂任务建议调用思考模式(reasoning_effort=high/max),追求快速应答和高并发场景切入Flash版。有评测发现,Flash版在部分轻任务上的效率和稳定性反而优于Pro,说明模型选型应从场景出发而非盲目追求旗舰版。

第二,善用缓存机制降低成本。对于长文档处理、多轮对话等重复性任务,合理复用上下文缓存能够显著减少输入token开销。实测显示,跑完一个完整数据库开发任务约有20万token消耗,仅约5元成本。

第三,关注本地部署机会。V4权重以MIT协议开源,支持本地部署,预计可在本地双RTX 4090或单RTX 5090上运行。对数据敏感度高的企业而言,本地化部署是一条值得考虑的路线。

第四,注意旧版API迁移窗口。DeepSeek v4的deepseek-chat与deepseek-reasoner旧模型名将于2026年7月24日停止服务,涉及大量迁移工作的企业需要尽早着手。

无论如何,DeepSeek V4的发布用事实回应了外界的质疑:它没有掉队,而且仍在以独特的技术路线向顶级闭源模型稳步靠近。正如DeepSeek在发布中引用《荀子》所言——“不诱于誉,不恐于诽”。对于大模型行业的竞争,归根结底是成本结构和工程深度之争;而V4,显然还在保持定义这场竞争的主动权。

以上是“企小脉”对DeepSeek V4的首发观察。欢迎在留言区留下你的问题和观点。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...